Credit Scoring. Über mehrere Jahre verantwortete Prof Szepannek die Scoring und Ratingmodellierung innerhalb der Santander Consumer Gruppe. Die Weiterentwicklung von Verfahren zur Kreditrisikomodellierung bildet auch weiterhin einen inhaltlichen Schwerpunkt seiner Forschungstätigkeiten.

KI optimieren. Bei der Erzeugung von KI-generierten Vorhersagemodellen stehen eine Vielzahl von Verfahren zur Verfügung. Jedes einzelne Verfahren bietet zudem ein Vielfalt an einstellbaren Parametern, um das Modell fein zu justieren. Prof. Szepannek und sein Team erforschen, wie mittels der sogenannten Hyperparameteroptimierung die besten Einstellungen automatisch bestimmt werden können.

Erklärbare KI. Neuronale Netze und andere KI-Verfahren erzeugen häufig Modelle, die als Black Boxes für den Menschen nur schwer verständlich sind. Auf die von KI-generierten Modellen sollte man nicht blind vertrauen; eine endgültige Entscheidung sollte stets beim Menschen liegen. Prof. Szepannek forscht daran, KI für den Menschen erklärbar zu gestalten, damit einzelne Personengruppen nicht unbeabsichtigt benachteiligt werden.

Kompetenzen im Bereich der künstlichen Intelligenz und Data Science

- Credit Scoring

- Computational Statistics

- Hyperparametertuning von Machine Learning Algorithmen

- Erklärbare KI und Interpretierbarkeit von Black Boxes

- Sentiment-Analyse und Text-Mining

Prof. Dr. Gero Szepannek

Statistik, Wirtschaftsinformatik und Machine Learning, Hochschule Stralsund

Ausgewählte Projekte

mlr³ Shiny

mlr³ ist ein beliebtes Framework für die Nutzung von maschinellen Lernverfahren für die Programmiersprache R. Das unter Leitung von Prof. Szepannek an der Hochschule Stralsund entwickelte mlr³ Shiny liefert eine grafische Oberfläche für die Spezifikation der grundlegenden Schritte eines Workflows für maschinelles Lernen. Mittels einer Browser-basierten Oberfläche können selbst KI-Neulinge schnell erste Modelle erzeugen.

Über die grafische Oberfläche lassen sich alle Aufgaben zusammenstellen, angefangen beim Datenimport, über das Trainieren der Modelle hin zur Nutzung des Modells auf neuen Daten.

Weitere Informationen zum Projekt finden Sie hier.

eXplAInability — erklärbare KI

Neben den Potenzialen, die künstliche Intelligenz birgt, dürfen auch die mit KI verbundenen Risiken nicht ignoriert werden, so gab es in der jüngeren Vergangenheit auch immer Beispiele von Fehlverhalten künstlicher Intelligenz, wie beispielsweise den rassistischen Chatbot von der Firma Microsoft. Nicht ohne Grund fordert die Bankenaufsicht Transparenz von Modellen die zur Risikomodellierung eingesetzt werden, um Finanzkrisen vorzubeugen und das BDSG enthält einen Passus zur Erklärbarkeit von algorithmenbasierten Entscheidungen. Prof. Szepannek forscht an Verfahren, die ein besseres Verständnis für die von KI erzeugten Modelle schaffen. Mit eXplAInability entwickelt das Team um Prof. Szepannek eine Bibliothek für die Programmiersprache R, um die Erklärbarkeit von ML-Verfahren zu quantifizieren.

Weitere Informationen zum Projekt finden Sie hier.

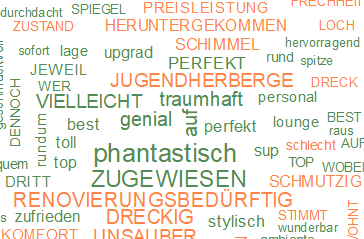

Text-Mining in Tourismus und betrieblichem Dokumentenmanagement

In verschiedenen Projekten setzt Prof. Szepannek mit seinem Team Text-Mining sein. So untersucht er u.a. Reiseberichte auf Blogs, um subjektive Qualitätskriterien der Reisenden zu identifizieren. Darüber hinaus stellte er mittels Text-Mining einen Zusammenhang zwischen Kundenbewertungen im Internet, die in Textform vorliegen, und Bewertungen, die in Sternen abgegeben wurden, fest. Es zeigte sich, dass anhand bereits anhand des Textes die Sternebewertung vorhergesagt werden kann. In einem weiteren Projekt untersuchte er die automatisierte Klassifizierung von E-Mails in Unternehmen, so dass diese direkt an die richtigen Adressaten, zum Beispiel Support-Anfragen an die richtige Abteilung, weitergeleitet werden.